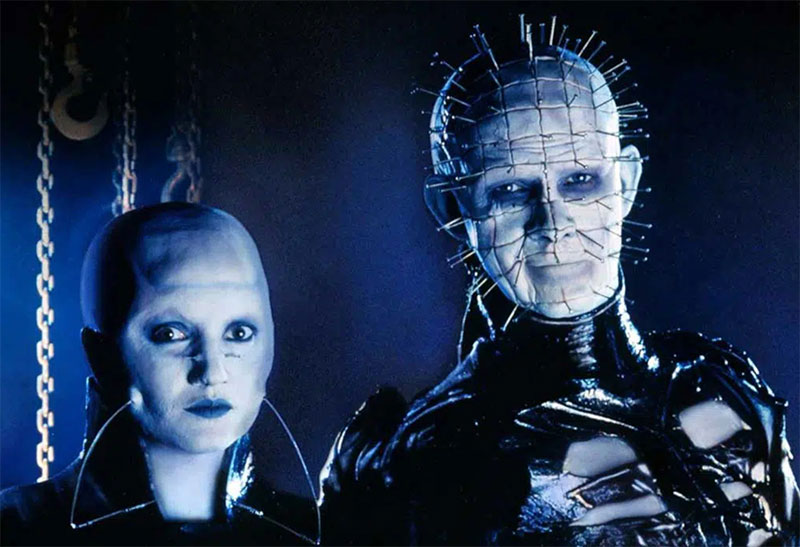

Товарищ Жуков (слово товарищ употреблено мною тут совершенно осознанно, Клим — коммунизд) тут разразился гневной статьёй про то, что, мол, гости гражданина Эпштейна — это сенобиты. Сенобиты, если вдруг кто забыл, — это граждане из франшизы Hellraiser.

https://t.me/klimzhukoff/6897

Жуков, как обычно, свёл всё к копетализьму — мол, когда капиталистам выпендриться больше нечем, они начинают выпендриваться покупкой людей.

Исторические наблюдения, правда, показывают, что с секс-гаремами и в СССР был полный порядок. Лаврентий Палыч не даст соврать. И если рассказы о том, что конкретно Берия делал (и с кем), можно объявить враками, то протоколы обыска, где фигурируют подарки в виде интимной женской одежды заграничного производства (включая детские (!) размеры), а также некий «набор мужчины-развратника» (что бы это ни означало), — это уже факты. У Ягоды, к слову, помимо детской одежды и игрушек нашли ещё и порнографию вместе с резиновым членом.

Но поговорить мне хотелось не о детских гаремах мужчин, власть предержащих. Такое, увы, было (и будет) всегда. Да, с этим надо бороться, и дело тут, увы, далеко не в общественной формации.

Поговорить мне хотелось о сенобитах.

Во-первых, примерно 95% людей, смотревших Hellraiser, как водится, нихрена в нём не поняли.

Сенобиты — это не от слов «сено» и «биты» (которые восемь бит — один байт). Это, вообще-то, «киновиты» — монахи, проживающие в киновии, монашеской коммуне. Представители религиозного ордена. Просто орден этот в фильме… мягко говоря, не христианский.

У Баркера они не демоны, не бесы, не «монстры с крюками». Они — орден. С собственной теологией, собственной дисциплиной, и собственной философией боли.

Во-вторых, Клайв Баркер — это не простой английский слесарь, а гражданин довольно специфических интересов.

Клайв — гомосексуалист, в молодости работал в эскорт-услугах. Он был глубоко вовлечён в культуру садомазохизма и часто посещал BDSM-клубы, с завсегдатаев которых, собственно, и срисовал своих сенобитов.

А про что, вы думали, были все эти цепи, крюки, кожаные шмотки? Для красоты? Нет, конечно, это всё красиво — если вам нравится кожаная субкультура, зачастую связанная с садомазохизмом. Поищите в интернетах фразу leather daddy (только, умоляю, не на работе и не в присутствии детей) — найдёте там столько «сенобитов», сколько сможете унести 😉 Ну, и альбомы финского Тома могу ещё порекомендовать.

К участию в BDSM приходят, когда желают испытать наслаждение, граничащее с болью. И приходят добровольно. Сенобиты у Баркера не развращают — они отвечают на зов. Они приходят к тем, кто сам открыл коробку.

И тут есть один важный момент.

Посетители Эпштейна — это не сенобиты. Отнюдь.

Сенобиты не охотятся на детей. Они не ломают чужую волю. Они работают только с теми, кто сам ищет крайности.

Это Эпштейн — самый главный сенобит. Это к нему приходили «за наслаждением». Добровольно. По собственному желанию. А вот те, кого он втягивал в эту историю при помощи той же Гислейн Максуэлл, — никакой коробки не открывали.

В реальной жизни, когда любой сексуальный контакт переходит рамки согласия, граждане отправляются в тюрьму — как это и должно быть. И посетители «сенобита» Эпштейна, если они действительно всем этим занимались (что ещё должно быть доказано в суде — одного «общественного порицания» тут недостаточно), должны отправиться именно туда.

Потому что дело тут не в капитализме.

И не в коммунизме.

И даже не в коже, цепях, и эстетике боли — в конце концов, кто я такая, чтобы указывать взрослым людям, что они могут делать со своим телом.

Это вообще не вопрос идеологии.

Вопрос — в согласии.

P.S. С доказательной базой в подобных делах всё, как правило, печально. Одних дневников и слухов для приговора недостаточно — суд требует доказательств, а не общественного возмущения. И это правильно, как бы ни хотелось иногда обратного. Презумпция невиновности существует не для удобства преступников, а для защиты невиновных. Это принцип, который не стоит разрушать даже в самых отвратительных делах.