Я как-то довольно давно пытался осилить книгу «Сумма Технологии» великого польского писателя. Как водится, ни черта в ней не понял, и забросил. А теперь подобрал по-новой, и вот что я вам скажу — какой же Станислав Лем был, сцк, умный.

Предсказывать будущее правильно может исключительно малое количество людей. Я, например, не могу. И в целом оно сводится к «через пять лет будет всё то же самое, но лучше», а «что будет через пятьдесят лет — предсказать не может никто».

Так вот, Лему — удаётся предсказать будущее и далее пятидесяти лет. Книгу он написал в 1963 году, и коснулся самых разных тем. В том числе он очень и очень много говорил о искуственном интеллекте. И вот двумя вещами я хочу тут поделиться. Помните, когда человечество думало, что автоматизировать будут только тяжёлый механический труд, а люди будут свободными от этого труда, чтобы заниматься Творчеством?

А Лем — шестьдесят лет назад, блин! — сказал по этому поводу вот что:

«Говорят, что можно будет автоматизироватьтолько нетворческую умственную деятельность. Где доказательства? Скажем определенно: их нет и, более того, не может быть. Голословно утверждаемая «невозможность» автоматизировать творческий труд представляет не большую ценность, чем библейское утверждение о том, что человек всегда будет добывать хлеб в поте лица своего.»

И был на 120% прав. На данный момент автоматизируют как раз эту самую творческую деятельность, а человеческий труд тех же сантехников, строителей, или сварщиков — абсолютно никакой угрозе со стороны ИИ не подвергается, и врядли вообще будет ей подвержен.

А ещё Лем с удивительной точностью предугадал наши дорогие нейронные сети в главах «Усилитель интеллекта» и «Чёрный ящик». Более того — он обосновал необходимость именно подобного подхода, вместо традиционного алгоритмического, к решению проблем систем искуственного интеллекта! Несколько цитат:

«Однако я останавливаюсь на примере усилителя интеллекта потому, что на нем нагляднее видна та фундаментальная трудность, с которой сталкивается в подобных задачах конструктор. Дело в том, что он должен создать устройство, которое было бы «умнее его самого». Ясно, что если бы он хотел действовать согласно методу, который стал уже традиционным в прикладной кибернетике, то есть если бы он стал разрабатывать программу работы своей машины, то поставленная задача не была бы решена: наличие программы ставит предел «интеллектуальности», достижимой для создаваемой машины. На первый взгляд — но только на первый — задача представляется неразрешимым парадоксом… Но существует (пока лишь гипотетическая) возможность совершенно иного подхода к проблеме. Детальные сведения о внутреннем устройстве усилителя интеллекта нам недоступны. Но, быть может, они и не нужны? Нельзя ли смотреть на этот усилитель как на «черный ящик», то есть как на устройство, о внутреннем строении и последовательных состояниях которого у нас нет ни малейшего понятия, как на устройство, в котором нас интересуют только конечные результаты его действия? Подобно всякому уважающему себя кибернетическому устройству, усилитель интеллекта обладает «входами» и «выходами»; между ними простирается область нашего неведения. Но чему это повредит, коль скоро данное устройство и в самом деле ведет себя так, как интеллект с показателем интеллектуальности, равным 10000?!»

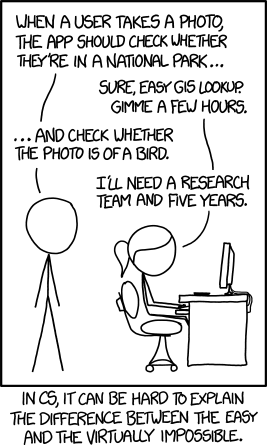

Послушайте, это же гениально — понять это шестьдесят с гаком лет назад! Невозможность решения даже элементарной, по текущим меркам, задачи распознания паттернов ИИ только при помощи написания алгоритмов с длинными блоками if {} else {} хорошо показывает комикс XKCD (разумеется, он есть на любую тему), неплохо отражащий реалии года эдак 2010-го (каких-то 15 лет назад, блин):

Поэтому любая нейросеть — это натуральный лемовский «чёрный ящик». Физически и алгоритмически в ней нет ничего сложного — искуственные нейроны (перцептроны) придумали ещё в 1950х годах. Просто тогда не знали, как их надо объединять в сети, что слоёв нужно много — для элементарных логических операций типа OR, AND, и так далее — нужно уже минимум три слоя. Ну, и не знали, как их правильно тренировать. А теперь знаем — и математика там реально несложная, начала матанализа. Но как конкретно ведут себя эти искуственные нейроны, какие веса каких взаимных связей приводят к какому действию — мы понимаем примерно НИКАК. Но пользуемся, потому как «данное устройство и в самом деле ведет себя так, как интеллект с показателем интеллектуальности, равным 10000».

Ещё цитата:

«Инженерное искусство ведет себя сегодня примерно так же, как человек, который даже и не пытается перепрыгнуть через канаву, пока предварительно теоретически не определит все существенные параметры и связи между ними: силу гравитации в данном месте, силу собственных мышц, кинематику движений своего тела, характеристики процессов управления, происходящих в его мозжечке, и т. д… И решение нашей проблемы состоит именно в том, чтобы усилитель интеллекта не занимался формализацией, конструированием, вербализацией, а действовал бы так же автоматически и «наивно» и в то же время так же искусно и безошибочно, как и нейронные структуры прыгуна, — чтобы этот усилитель не занимался ничем, кроме преобразования сигналов, приходящих на «вход» с целью получения готовых результатов на «выходе». Ни он, этот усилитель, ни его конструктор — никто вообще — совершенно не будет знать, как усилитель это делает, зато мы получим то единственное, чего добиваемся: нужные результаты.»

Нет, Лем — это не голова. Это минимум две головы, а то и три. Увидеть то, к чему мы пришли в первой четверти 21 века, из реалий 1960х годов — я себе не представляю, насколько реально умным человеком надо быть. Обалдеть просто.