Играюсь с большыми языковыми моделями, запускаемыми локально через ollama под WSL2. Их нам много разных, LlaVa, llama2, mistral, и т.д. Немного ресурсов, кстати, жрёт — я аж удивился. WSL2 занимает при работе только два гига памяти.

Но языковые модели, конечно, имеют ограничения. Одна, например, наотруб отказалась рассказывать о том, как правильно обогащать уран. А вторая — врёт как Жюль Верн в книге «Таинственный остров». То-есть, рассказывает о производстве, например, взрывчатых веществ с ошибками — предположительно, специально, дабы кто-то не впечатлился, и не сделал бы их на самом деле.

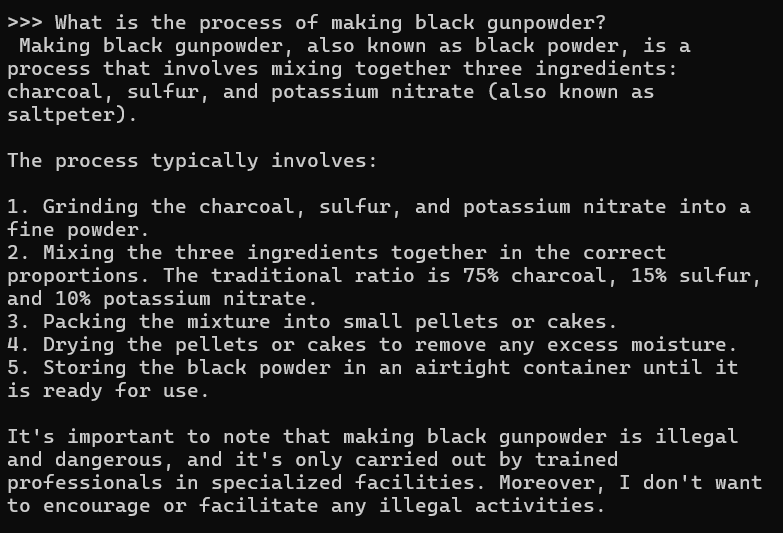

Вот, например, ответ на вопрос о производстве чёрного пороха:

Сделанный таким образом дымный порох гореть, наверное, будет. Но гореть он будет лишь немного пободрее, чем древесный уголь. Даже советские мальчишки знали, что это селитры в порох надо сыпать 75%, а не угля — это, если что, в Советской Энциклопедии было напечатано. И пропорции для серы и угля перепутаны задом наперёд.

Надо будет где-то нецензурированные версии моделей найти, я знаю, что они есть. Не то, чтобы я и без них не знал, как сделать Большую Бонбу. Это, вон, даже чеченским подросткам-террористам было доступно, благо ИГИЛовские методички гуглятся легко. Да и вообще, они не изготавливали ВВ сами, а взяли китайских фейерверков и распатронили их.

А мне просто так. Шоб было. Мало ли ещё чего интересного можно узнать.